Exploration des risques du développement

non maîtrisé de l'intelligence artificielle

Heart Leadership University a ouvert une recherche-exploration sur l’un des trois grands défis du XXI° siècle : les risques d’un développement non maîtrisé de l’intelligence artificielle. Si le sujet fait régulièrement l’actualité depuis la sortie de ChatGPT, il s’agit ici d’aborder des questions pour l’instant peu mises en lumière. Qui sont les grands bénéficiaires et les perdants du déploiement massif de l’intelligence artificielle ? Pour servir quelles finalités ce développement est-il mis en œuvre ? La massification des décisions automatisées via les algorithmes restreint-elle la liberté de choix et/ou la capacité des humains, et en particulier des dirigeants, à décider en mobilisant leurs aptitudes sensibles, leur intelligence du cœur (intuition, empathie, courage) ?

Objectifs du projet

Alors que l’intelligence artificielle (IA) est testée et déployée de façon croissante quel que soit le secteur, HLU entend contribuer aux réflexions sur les apports et les risques de ce développement. Et ceci à trois niveaux :

- À l’échelle individuelle, et du dirigeant en particulier, en quoi l’IA peut-elle priver l’humain de la possibilité de décider avec sensibilité (intuition, empathie)? Les algorithmes vont-ils nous priver de la capacité à décider de manière « humaine » ? Le chiffre et le calcul auront-t-ils toujours raison en dernier ressort?

- À l’échelle des acteurs économiques, qui sont les acteurs dominants ? Quel est le niveau de concentration des pouvoirs et quels sont les éventuels contre-pouvoirs ? Quels sont les impacts du développement d’une économie fondée sur la donnée en termes de captation de la valeur, de rapport de pouvoir entre les acteurs économiques et de souveraineté ?

- À l’échelle de la planète, du vivant et de l’humanité, peut-on penser que les technologies et dispositifs déployés auront une orientation « durable » ou bénéfique au bien commun ? Sommes-nous au contraire en train d’accélérer l’exploitation, la privatisation et l’accaparement des ressources, l’accroissement des inégalités… ?

Il s’agit en particulier d’aider au discernement des dirigeants d’entreprise. Les informations et formations destinées à ce public sont en effet aujourd’hui souvent conçues pour les amener à adopter l’IA sans nécessairement questionner leur pertinence ou leur adéquation aux problématiques de leur structure.

Phase prospective (2024-2025)

HLU en partenariat avec Futuribles, centre de réflexion sur l’avenir, et le CJD, a engagé un travail prospectif pour permettre aux dirigeants d’entreprise français de se projeter dans différents scenarios de déploiement de l’IA à l’horizon 2035.

Trois scénarios à horizon 2035 centré sur la place de l’IA dans les contextes envisagés ont été conçus :

- Presque le monde d’après. Confrontée a un monde de plus en plus fragmenté, à la multiplication des catastrophes climatiques, et à sa dépendance croissantes aux ressources naturelles étrangères, l’Europe a tiré les leçons de ces fragilité pour amorcer une transition écologique fondée sur la sobriété. La consommation de numérique est limitée et des modèles d’IA souverains sont développés avec des usages ciblés sur la transition, la cohésion sociale et la défense.

- Jules te regarde. Après l’ultra-krach de 2029, les Etats-Unis sont empêtrés dans une récession économique et de très fortes tensions sociales et politiques internes. L’amoindrissement de leur influence internationale profite à la Chine. En Europe, le modèle de la démocratie libérale est décrédibilisé ; les régimes autoritaires se développent, comme en France avec l’élection en 2032 de Jules, premier président « pérenne ». Il mène une politique à la fois populiste, pro-business, et techno- autoritaire, largement fondée sur les solutions numériques chinoises en particulier dans la sécurité.

- Welcome to GAFAMLAND. Depuis l’élection de Donald Trump fin 2024, la collusion entre intérêt privé et public n’a fait que s’approfondir. Les Big Tech sont devenues des méganationales, incontournables de l’ensemble des chaînes de valeur économique. Prioritaires dans l’accès à l’énergie et aux ressources naturelles, elles ont une influence politique et sociale considérable. L’Europe et la France sont devenus de véritables colonies numériques dépendantes des solutions des Big Tech. A l’exception de quelques rares entreprises ayant développés des cas d’usage à succès, le Continent n’a pas vu émerger un secteur tech compétitif. Le développement de l’IA a conduit à une polarisation des organisations (grandes entreprises vs PME), et des travailleurs (destruction d’emploi peu qualifié, intensification du travail dans les grandes structures). Le monde du travail est devenu IA-dépendant et IA-orienté.

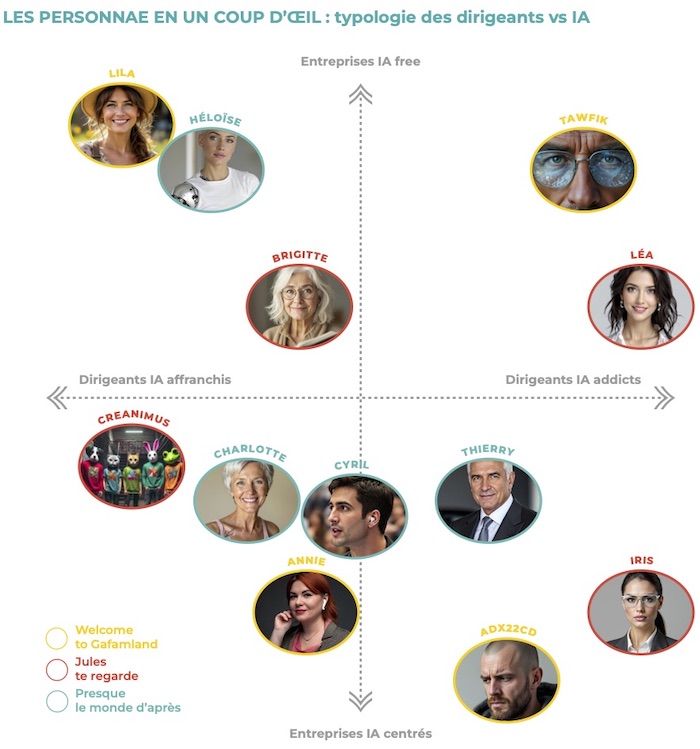

Au cours de trois ateliers créatifs, ces scénarios ont été soumis à un public de décideurs (dirigeants, acteurs du monde de l’entreprise) avec pour mission d’imaginer des dirigeants et des entreprises de 2035. Sur le graphique suivant, ils sont classés en fonction de la relation qu’ils entretiennent avec l’IA, et de la place que ces technologies occupent dans l’organisation et l’offre de leur entreprise.

Phase exploratoire (2023-2024)

Réalisée avec Amal Marc et Laure Lucchesi, cette phase a permis de dresser un panorama des enjeux au niveau global et pour le dirigeant. Les travaux ont été alimentés par des recherches bibliographiques, des interviews d’experts ainsi que des focus group organisés en partenariat avec le CJD, afin de recueillir des témoignages sur la façon dont les dirigeants se questionnent et se positionnent face au déploiement de l’IA. Voici quelques-uns des enseignements de cette exploration.

La dépendance, au coeur des enjeux globaux.

- L’IA n’est pas artificielle mais extrêmement matérielle – ce qui pose un enjeu majeur de dépendance aux ressources (énergie, eau, métaux), et de responsabilité élargie du dirigeant, dans une perspective de durabilité.

- La compétition mondiale sur l’IA est largement dominée par le duopole États-Unis / Chine ; et la chaine de valeur par les Big tech du numérique. Dans un tel contexte, les entreprises européennes sont à ce jour cantonnées au rôle de développeur d’application spécifique (use case) et de façon plus générale à celui d’usager de technologies produites ailleurs. Cela pose de nouveau la question de la dépendance (économique cette fois) ainsi que celle du contrôle qui en découle.

Au niveau de l’entreprise, les travaux ont permis de distinguer des zones de pertinence de l’IA ainsi que des cas d’usage qui peuvent être interrogés :

- soit parce que les SIA seraient amenés à opérer dans des contextes trop volatils et incertains pour qu’ils soient durablement utiles, questionnant leur réel retour sur investissement ;

- soit parce qu’ils emportent des risques élevés de perte de recul, d’intuition ou de résilience pour l’individu comme pour l’organisation ;

- soit parce qu’il s’agit d’usages non éthiques ou superflus (effet de mode, marketing hype…), conduisant à un gaspillage de ressources.

Les dirigeants interrogés oscillent entre fascination par une « IA magique » (d’une praticité et rapidité fulgurantes, et désormais « générative ») et répulsion envers une « IA tragique ». Plus généralement, si certains identifient les conséquences adverses du déploiement de l’IA pour leur entreprise et leur pratique du leadership (perte de pouvoir, de compétences, appauvrissement des relations, cyberrisques etc.), le lien aux enjeux globaux et la question de la responsabilité du dirigeant aux bornes de son entreprise font nettement moins partie de leurs réflexions…